No cenário atual da tecnologia, os Modelos de Linguagem de Grande Escala (LLMs) estão brilhando sob os holofotes, graças a gigantes como o ChatGPT. Com a entrada em cena dos modelos Llama da Meta, uma onda de entusiasmo por LLMs de código aberto varreu a comunidade tech. A meta ambiciosa? Desenvolver LLMs que não só se equiparem a grande tecnologias como o GPT-4 em eficiência, mas que também sejam abertos e acessíveis, sem o peso do custo ou da complexidade.

Essa fusão entre acessibilidade e alta desempenho está abrindo portas para inovações no processamento de linguagem natural, pavimentando o caminho para uma era repleta de avanços tecnológicos. O campo de IA generativa está igualmente efervescente, atraindo investimentos significativos. Startups inovadoras, como a Junto, atraíram um investimento de 20 milhões de dólares. Por outro lado, a Anthropic e a Cohere, em parceria com o Google Cloud, conseguiram garantir 450 e 270 milhões de dólares respectivamente. Isso indica um grande interesse no desenvolvimento e crescimento da Inteligência Artificial de código aberto.

Descobrindo o Mistral 7B

Da vibrante Paris surge a Mistral AI, uma startup promissora fundada por talentos oriundos do DeepMind e Meta do Google. Eles acabam de desvendar o Mistral 7B. Este gigante tecnológico, com seus impressionantes 7 bilhões de parâmetros, está ao alcance de todos, disponível para download no GitHub e também como um prático Torrent de 13.4 GB.

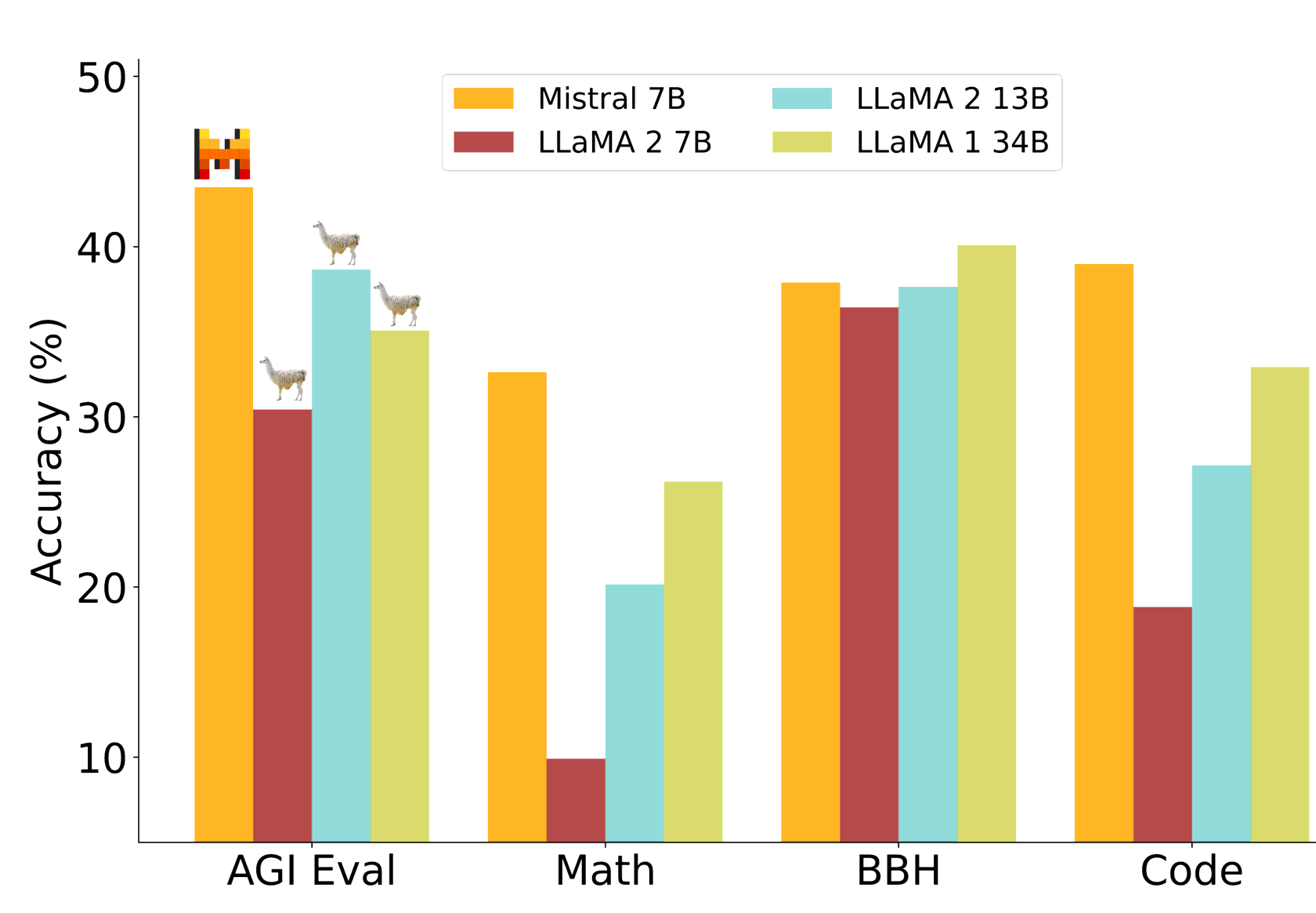

Antes mesmo de seu lançamento, a Mistral AI já havia captado um financiamento inicial recorde. O modelo Mistral 7B se destaca notavelmente, superando o desempenho do Llama 2 13B em testes abrangentes e rivalizando com o Llama 1 34B em várias métricas importantes.

O Mistral 7B se diferencia dos seus concorrentes, como o Llama 2, por oferecer funcionalidades comparáveis ou até superiores, porém com uma sobrecarga computacional significativamente menor. Enquanto modelos estabelecidos como o GPT-4 podem atingir resultados mais amplos, eles vêm com um custo mais elevado e uma acessibilidade limitada, principalmente por meio de APIs.

Em tarefas de programação, o Mistral 7B mostra seu verdadeiro valor, desafiando diretamente o CódigoLlama 7B. Sua estrutura compacta de apenas 13.4 GB permite que ele opere eficientemente em computadores convencionais.

Além disso, a versão Mistral 7B Instruct, finamente ajustada para datasets instrucionais, demonstrou um desempenho excepcional, superando outros modelos de 7 bilhões de parâmetros no MT-Bench e equiparando-se aos modelos de chat de 13 bilhões de parâmetros. Esta inovação não é apenas um marco tecnológico, mas também um avanço significativo na democratização da inteligência artificial.

Mistral 7B Define Novos Padrões

Após uma análise minuciosa de desempenho, o Mistral 7B se destacou como um gigante no universo da inteligência artificial. Comparado aos renomados modelos da família Llama 2, ele não apenas os alcançou em eficiência, mas também rivalizou com o gigante Llama 34B, especialmente em áreas críticas como raciocínio lógico e programação.

O leque de benchmarks abrangia categorias diversas, incluindo raciocínio de senso comum, conhecimento global, compreensão de texto, matemática e habilidades de codificação. Notavelmente, o Mistral 7B se destacou por oferecer um desempenho comparável a modelos Llama 2 três vezes maiores, um feito que promete significativa economia de memória e melhor rendimento. Embora em testes relacionados ao conhecimento geral ele se alinhasse mais com o Llama 2 13B, isso é reflexo de uma otimização equilibrada dos seus parâmetros, visando a eficiência na gestão da informação.

Saiba mais em: Performance em detalhes Mistral 7B

Decifrando a Excelência do Mistral 7B

Em meio ao universo dos modelos de linguagem, o Mistral 7B desponta com uma característica distintiva: a eficiência de seus mecanismos de atenção. Imagine a experiência de ler um livro, sublinhando trechos cruciais para entender a história. De maneira similar, os mecanismos de atenção do Mistral 7B realçam as partes mais significativas dos dados, assegurando respostas precisas e contextualmente adequadas.

Nos modelos convencionais, a atenção é calculada por uma fórmula complexa que expande matrizes à medida que as sequências crescem, tornando o processo lento, especialmente com dados extensos.

Aqui entra a inovação do Mistral 7B: ele usa a atenção multi-consulta (MQA), que acelera o processamento ao empregar um conjunto de "cabeças" de valor-chave. Mas, e se pudéssemos fundir a rapidez do MQA com a precisão da atenção detalhada? O Mistral 7B responde a este desafio com a atenção de consulta agrupada (GQA), um método que combina o melhor dos dois mundos, proporcionando eficiência sem comprometer a qualidade. Este equilíbrio inovador é o que coloca o Mistral 7B à frente de seus concorrentes no campo da inteligência artificial.

Explorando a Inovação com a Atenção à Janela Deslizante nos Transformadores Longformer

Imagine uma tecnologia de Inteligência Artificial (IA) treinada, altamente avançada, que coordena o uso de unidades de dados chamadas 'tokens' em sequências de atenção. Essa IA utiliza um método chamado Atenção à Janela Deslizante (SWA), que se destaca como um mestre virtuoso na análise desses 'tokens'. O SWA aborda cada 'token' individualmente, aplicando uma janela de atenção de tamanho fixo para examinar detalhadamente cada um deles.

No entanto, a inovação não para aí. O modelo Longformer aprimora essa técnica com sua versão "atenção dilatada da janela deslizante". Ao focar apenas em algumas diagonais específicas da matriz de atenção, esta abordagem aumenta a eficiência, crescendo linear e não exponencialmente com o tamanho da sequência. Esta sutileza brilhante permite ao Longformer lidar com sequências mais extensas de maneira mais ágil e eficiente, abrindo caminhos para um processamento de linguagem natural mais robusto e dinâmico.

Versatilidade Inigualável na Implantação do Mistral 7B

Destacando-se no universo dos modelos de linguagem, o revolucionário Mistral 7B brilha com sua disponibilidade sob a renomada licença Apache 2.0. Essa escolha estratégica elimina barreiras convencionais de uso, abrindo um leque de possibilidades para indivíduos, gigantes corporativos e até entidades governamentais. Seja em sistemas domésticos ou em ambientes de nuvem sofisticados, o Mistral 7B promete uma integração sem esforço.

Enquanto outras licenças, como a simplista MIT e a colaborativa CC BY-SA-4.0, têm seu charme, a Apache 2.0 se destaca por sua solidez, formando uma plataforma ideal para projetos de grande magnitude. Com esta liberdade sem precedentes, o Mistral 7B não é apenas uma ferramenta tecnológica; é um convite para explorar o potencial ilimitado da IA em qualquer escala.

Além do Horizonte com o Mistral 7B

Finalizando esta jornada pelo universo do Mistral 7B, fica evidente que estamos testemunhando não apenas um avanço tecnológico, mas uma verdadeira revolução na inteligência artificial.

Este gigante da inteligência artificial, com sua capacidade extraordinária e novos mecanismos de atenção, redefine os limites do possível no processamento de linguagem natural. Sua acessibilidade e performance, equilibradas sob a licença Apache 2.0, abrem caminho para uma era onde a inteligência artificial de alto calibre é uma realidade tangível para todos.

O Mistral 7B não é apenas um marco no campo da IA; é um farol que ilumina o caminho para um futuro onde a tecnologia de ponta é sinônimo de inclusão e progresso coletivo.